如何在STM32上运行AI应用

2024-09-29

1018

来源:米尔电子

1.X-Linux-AI概述

X-LINUX-AI 是 STM32 MPU OpenSTLinux 扩展包,面向 STM32MP1 和 STM32MP2 系列微处理器的人工智能。它包含 Linux® AI 框架,以及用于开始一些基本使用案例的应用程序示例。

X-LINUX-AI 中提供的示例包括一系列用于图像分类、对象检测、语义分割和人体姿势估计的优化模型。X-LINUX-AI 中作为预构建二进制文件提供的人脸识别应用程序基于 STMicroelectronics 重新训练的模型。

这些示例依赖于基于 TensorFlow™ Lite 推理引擎、ONNX 运行时、OpenVX™ 或 Google Edge TPU™ 加速器的 STAI_MPU API。它们都支持 Python™ 脚本和 C/C++ 应用程序。本文内容将通过MYD-LD25X来演示这些示例demo。

1.1. 硬件资源

带有烧录好MYiR发布镜像的MYD-LD25X开发板

MY-LVDS070C屏幕或者任意HDMI接口显示器

MY-CAM003M米尔MIPI-CSI摄像头模块

1.2.软件资源

本文内容操作均在MYD-LD25X开发板的调试串口执行,请确保先完成了MYD-LD25X快速使用指南(也就是开发板附带的小册子)上的基本内容,并且需要确保开发板能够联通互联网,提供网络的方式有多种,可以是能够连接互联网的路由器,也可以是Wifi,Wifi具体的连接方式可以查阅发布资料中《MYD-LD25X Linux 软件评估指南》Wifi的STA连接章节。

2.开发板安装X-Linux-AI

本章主要介绍如何在MYD-LD25X开发板上安装X-Linux-AI以及相关demo组件等。

2.1.配置准备环境

1)获取校准参数

如果在MYD-LD25X使用LVDS屏幕,初次使用进入weston需要校准屏幕,校准的自动化脚本操作默认添加在autorun脚本中,如果已经执行过校准操作或者使用HDMI屏幕,则可以跳过该小节内容。

运行autorun.sh脚本执行校准操作:

# autorun.sh

执行后lvds屏幕会出现触摸点位,以此点击后完成校准,之后使用屏幕无需再次校准。

2)关闭HMI

避免出现显示冲突,在MYD-LD25X登录后,执行以下操作关闭mxapp2程序也就是MYiR的HMI界面:

# killall mxapp2

并且将autorun脚本中启动mxapp2的行注释掉,下次启动后就不会自动运行了:

# vi /usr/bin/autorun.sh #!/bin/sh ...省略 sync #/usr/sbin/mxapp2 &

3)更新软件源

执行以下命令更新软件源:

# apt update The software package is provided AS IS, and by downloading it, you agree to be bound to the terms of the software license agreement (SLA). The detailed content licenses can be found at https://wiki.st.com/stm32mpu/wiki/OpenSTLinux_licenses. Get:1 http://packages.openstlinux.st.com/5.1 mickledore InRelease [5,723 B] Get:2 http://packages.openstlinux.st.com/5.1 mickledore/main arm64 Packages [725 kB] Get:3 http://packages.openstlinux.st.com/5.1 mickledore/updates arm64 Packages [38.2 kB] Get:4 http://packages.openstlinux.st.com/5.1 mickledore/untested arm64 Packages [1,338 kB] Fetched 2,107 kB in 3s (690 kB/s) Reading package lists... Done Building dependency tree... Done 1 package can be upgraded. Run 'apt list --upgradable' to see it.

更新源需要MYD-LD25X连接互联网,请确保网络通畅。执行上述命令时,可能会出现以下问题导致更新错误:

l同步时间问题

E: Release file for http://packages.openstlinux.st.com/5.1/dists/mickledore/InRelease is not valid yet (invalid for another 1383d 8h 14min 14s). Updates for this repository will not be applied. E: Release file for http://extra.packages.openstlinux.st.com/AI/5.1/dists/mickledore/InRelease is not valid yet (invalid for another 1381d 8h 10min 47s). Updates for this repository will not be applied.

出现上述问题的原因是当前开发板时间没有和网络时间成功同步,执行以下操作同步网络时间,首先修改timesyncd.conf配置文件,新增FallbackNTP授时中心网站,按如下所示修改:

# vi /etc/systemd/timesyncd.conf ... [Time] #NTP= FallbackNTP=ntp.ntsc.ac.cn cn.ntp.org.cn ...

然后输入如下命令重启同步时间服务:

# systemctl restart systemd-timesyncd

再次输入date查看时间是否成功更新,根据网络情况不同部分情况可能需要一定时间同步:

# date 2023年 03月 03日 星期五 17:50:37 CST # date 2024年 09月 20日 星期五 15:45:15 CST

lDNS问题

运行apt update后可能会出现以下问题:

# apt update ... Err:1 http://packages.openstlinux.st.com/5.1 mickledore InRelease Temporary failure resolving 'packages.openstlinux.st.com' Reading package lists... Done Building dependency tree... Done All packages are up to date. W: Failed to fetch http://packages.openstlinux.st.com/5.1/dists/mickledore/InRelease Temporary failure resolving 'packages.openstlinux.st.com' W: Some index files failed to download. They have been ignored, or old ones used instead.

该问题需要修改/etc/resolve.conf,在文件中添加如下内容:

# vi /etc/resolv.conf ... nameserver 8.8.8.8 nameserver 8.8.4.4

2.2.安装x-linux-ai-tool

当完成环境配置后,输入以下命令安装x-linux-ai-tool:

# apt-get install -y x-linux-ai-tool

安装完成后,输入以下命令确认是否安装完成:

# x-linux-ai -v X-LINUX-AI version: v5.1.0

关于x-linux-ai工具的使用,可以通过x-linux-ai -h查看或者浏览官方wiki:

2.3.安装 X-LINUX-AI 演示包

要开始使用 X-linux-ai,需要安装 X-linux-ai 演示包,该包提供了针对所用特定目标优化的所有 Ai 框架、应用程序示例、工具和实用程序:

# x-linux-ai -i packagegroup-x-linux-ai-demo

2.4.运行demo启动器

ST的官方demo启动器在MYD-LD25X默认已经移除,为了方便使用X-linu-ai的demo应用,需要重新添加随weston自启动的官方demo展示程序。

进入/usr/local/weston-start-at-startup目录,并新建start_up_demo_launcher.sh脚本,按照如下操作添加对应内容到脚本中:

# cd /usr/local/weston-start-at-startup # vi start_up_demo_launcher.sh #!/bin/sh DEFAULT_DEMO_APPLICATION_GTK=/usr/local/demo/launch-demo-gtk.sh if [ -e /etc/default/demo-launcher ]; then source /etc/default/demo-launcher if [ ! -z "$DEFAULT_DEMO_APPLICATION" ]; then $DEFAULT_DEMO_APPLICATION else $DEFAULT_DEMO_APPLICATION_GTK fi else $DEFAULT_DEMO_APPLICATION_GTK fi

然后添加运行权限给脚本:

# chmod a+x start_up_demo_launcher.sh

最后重启weston服务后,可以看到启动器成功运行:

# systemctl restart weston-graphical-session.service

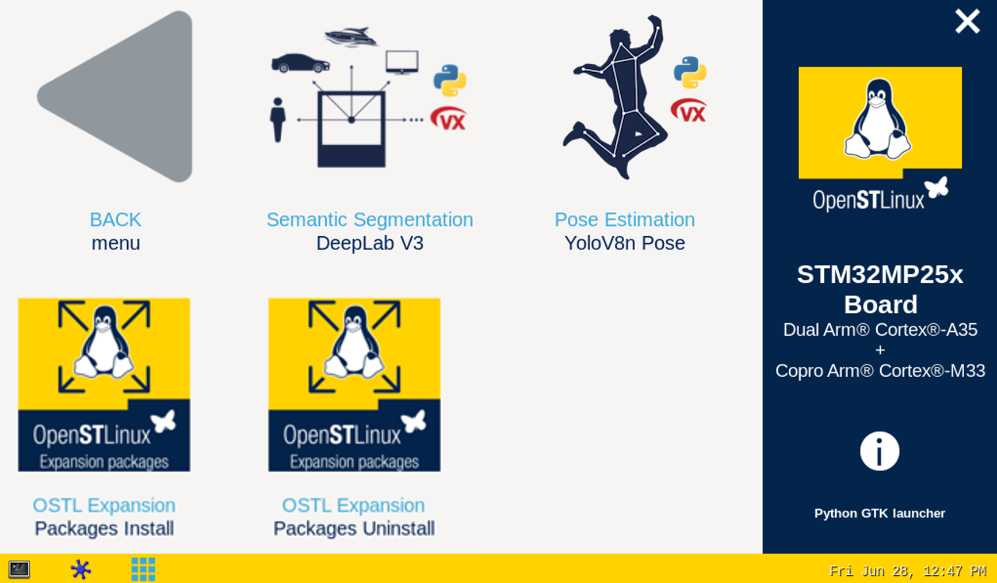

图2-1. demo启动器-1

图2-2. demo启动器-2

3.运行AI 应用实例

本章节将简单展示上文安装后的几个Demo具体情况,在执行Demo前,需要准备好1.1小节的硬件资源。

以下demo运行都需要使用到MIPI-CSI摄像头,适用于MYD-LD25X开发板的摄像头型号为米尔的MY-CAM003M,在使用该摄像头前需要按照以下命令来初始化配置并事先预览确保摄像头能够正常工作。

进入/etc/myir_test目录,运行myir_camera_play脚本:

# cd /etc/myir_test # ./myir_camera_play

执行后,屏幕上会出现摄像头预览画面,请确保画面显示正常,如果存在问题,请查阅《MYD-LD25X Linux 软件评估指南》中关于MIPI-CSI摄像头的部分检查摄像头连接情况等来排查问题,如有需要请咨询米尔技术支持。

3.1.图像分类

图像分类神经网络模型可以识别图像所代表的对象。它将图像分类为不同的类别。该应用展示了一个计算机视觉的图像分类用例,从相机输入(/dev/videox)捕获帧,并通过OpenVX、TFLite或ONNX框架解析的神经网络模型进行分析。

3.1.1.通过demo启动器运行

可以通过点击demo启动器中的Image Classifiction样例图标来运行该demo,默认情况下,通过2.3小节安装的是OpenVX的应用程序,并且由C/C++和Python两种。

图3-1. 图像分类

3.1.2.通过命令运行

图像分类的C/C++和Python应用程序位于/usr/local/x-linux-ai/image-classification/目录中,可以通过运行程序加-h参数来获取更多帮助信息:

# cd /usr/local/x-linux-ai/image-classification/ # ls -la stai_mpu_image_classification #C++运行程序 stai_mpu_image_classification.py #Python运行程序

为了简化demo的启动,在应用程序目录下有配置好的启动脚本:

使用相机输入启动图像分类demo

launch_bin_image_classification.sh #C++运行程序 launch_python_image_classification.sh #Python运行程序

使用图片输入启动图像分类demo

launch_bin_image_classification_testdata.sh #C++运行程序 launch_python_image_classification_testdata.sh #Python运行程序

3.1.3.demo展示

通过demo启动器启动默认为使用相机输入,和命令启动中使用相机输入的脚本运行结果一致,这里以C/C++程序为例,具体测试情况如下:

# cd /usr/local/x-linux-ai/image-classification # ./launch_bin_image_classification.sh #或者点击demo启动器图标

图3-2. 摄像机输入

运行图片输入的程序脚本前,需要准备识别的图片,这里以一张泰迪熊的图片为例,图片放置目录为/usr/local/x-linux-ai/image-classification/models/mobilenet/testdata,然后运行脚本,这里以C/C++应用程序为例。

# cd /usr/local/x-linux-ai/image-classification/models/mobilenet/testdata # ls -la -rwxr--r-- 1 root root 102821 9 20 23:14 teddy.jpg # cd /usr/local/x-linux-ai/image-classification # ./launch_bin_image_classification_testdata.sh

运行结果如下:

图3-3. 图片输入

3.2.对象检测

该应用展示了一个计算机视觉的对象检测用例,从相机输入(/dev/videox)捕获帧,并通过OpenVX、TFLite或ONNX框架解析的神经网络模型进行分析。使用Gstreamer管道来流式传输相机帧(使用v4l2src),显示预览(使用gtkwaylandsink),并执行神经网络推理(使用appsink)。

3.2.1.通过demo启动器运行

可以通过点击demo启动器中的Object Detection样例图标来运行该demo,默认情况下,通过2.3小节安装的是OpenVX的应用程序,并且由C/C++和Python两种。

图3-4. 对象检测

3.2.2.通过命令运行

对象检测的C/C++和Python应用程序位于/usr/local/x-linux-ai/object-detection/目录中,可以通过运行程序加-h参数来获取更多帮助信息:

# cd /usr/local/x-linux-ai/object-detection/ # ls -la stai_mpu_object_detection #C++运行程序 stai_mpu_object_detection.py #Python运行程序

为了简化demo的启动,在应用程序目录下有配置好的启动脚本:

使用相机输入启动对象检测demo

launch_bin_object_detection.sh #C++运行程序 launch_python_object_detection.sh #Python运行程序

使用图片输入启动对象检测demo

launch_bin_object_detection_testdata.sh #C++运行程序 launch_python_object_detection_testdata.sh #Python运行程序

3.2.3.demo展示

通过demo启动器启动默认为使用相机输入,和命令启动中使用相机输入的脚本运行结果一致,这里以C/C++程序为例,具体测试情况如下:

# cd /usr/local/x-linux-ai/object-detection # ./launch_bin_object_detection.sh #或者点击demo启动器图标

图3-5. 摄像机输入

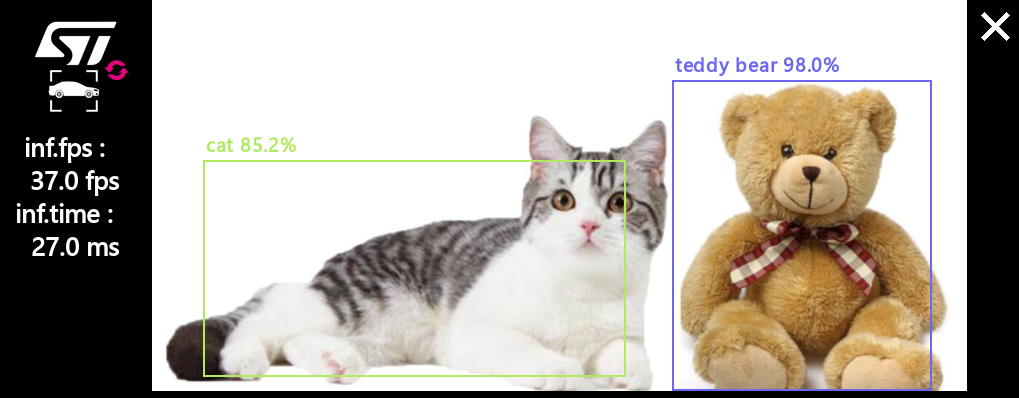

运行图片输入的程序脚本前,需要准备识别的图片,这里以一张泰迪熊和小猫的图片为例,图片放置目录为:

/usr/local/x-linux-ai/object-detection/models/coco_ssd_mobilenet/testdata

然后运行脚本,这里以C/C++应用程序为例。

# cd /usr/local/x-linux-ai/object-detection/models/coco_ssd_mobilenet/testdata # ls -la -rwxr--r-- 1 root root 102821 9 20 23:14 teddy-and-cat.jpg # cd /usr/local/x-linux-ai/object-detection # ./launch_bin_object_detection_testdata.sh

运行结果如下:

图3-6. 图片输入

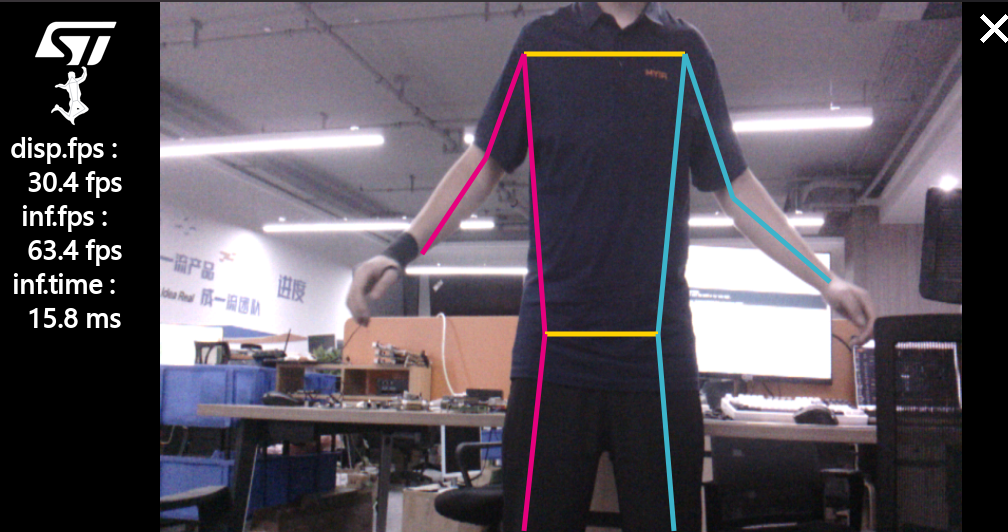

3.3.姿势估计

该应用展示了一个计算机视觉的人体姿态估计用例,从相机输入(/dev/videox)捕获帧,并通过OpenVX框架解析的神经网络模型进行分析。该应用使用的模型是从stm32-hotspot ultralytics的GitHub分支下载的ST YoloV8n-pose。

3.3.1.通过demo启动器运行

可以通过点击demo启动器中的Pose Estimation样例图标来运行该demo,默认情况下,通过2.3小节安装的是OpenVX的应用程序,默认为Python应用程序。

图3-7. 姿势估计

3.3.2.通过命令运行

姿势估计的C/C++和Python应用程序位于/usr/local/x-linux-ai/object-detection/目录中,可以通过运行程序加-h参数来获取更多帮助信息:

# cd /usr/local/x-linux-ai/pose-estimation/ # ls -la stai_mpu_pose_estimation.py

为了简化demo的启动,在应用程序目录下有配置好的启动脚本:

使用相机输入启动姿势估计demo

launch_python_pose_estimation.sh

使用图片输入启动姿势估计demo

launch_python_pose_estimation_testdata.sh

3.3.3.demo展示

通过demo启动器启动默认为使用相机输入,和命令启动中使用相机输入的脚本运行结果一致,这里以C/C++程序为例,具体测试情况如下:

# cd /usr/local/x-linux-ai/pose-estimation/ # ./launch_python_pose_estimation.sh #或者点击demo启动器图标

图3-8. 摄像机输入

运行图片输入的程序脚本前,需要准备识别的图片,这里以一张人跑步的图片为例,图片放置目录为:/usr/local/x-linux-ai/pose-estimation/models/yolov8n_pose/testdata,然后运行脚本,这里以C/C++应用程序为例。

# cd /usr/local/x-linux-ai/pose-estimation/models/yolov8n_pose/testdata # ls -la -rwxr--r-- 1 root root 102821 9 20 23:14 person-run.jpg # cd /usr/local/x-linux-ai/pose-estimation # ./launch_python_pose_estimation_testdata.sh

运行结果如下:

图3-9. 图片输入

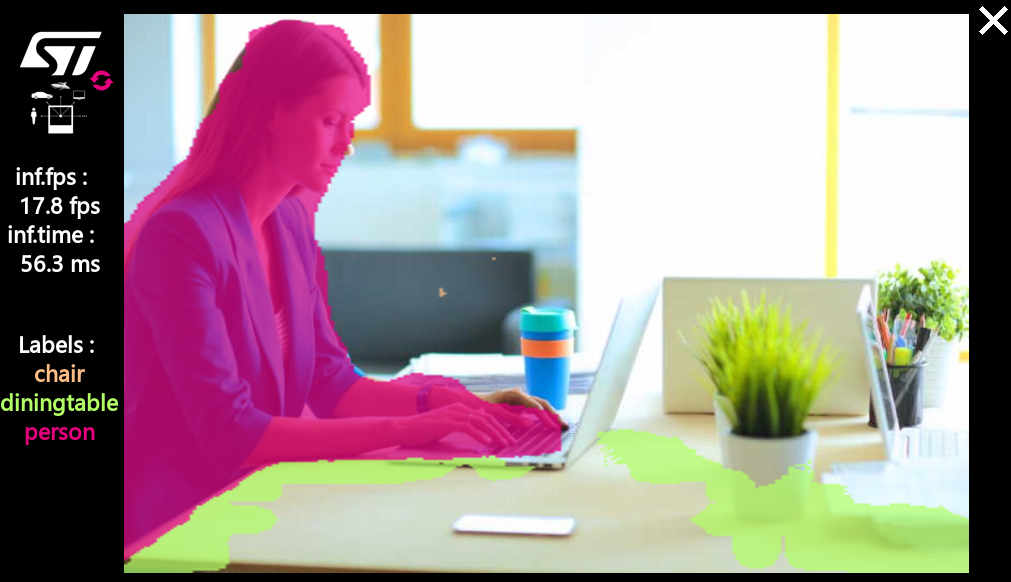

3.4.语义分割

该应用展示了一个计算机视觉的语义分割用例,从相机输入(/dev/videox)捕获帧,并通过OpenVX框架解析的神经网络模型进行分析。使用Gstreamer管道来流式传输相机帧(使用v4l2src),显示预览(使用gtkwaylandsink),并执行神经网络推理(使用appsink)。推理结果显示在预览中,叠加是使用GtkWidget和cairo实现的。该应用使用的模型是从TensorFlow™ Lite Hub下载的DeepLabV3。

3.4.1.通过demo启动器运行

可以通过点击demo启动器中的Semantic Segmentation样例图标来运行该demo,默认情况下,通过2.3小节安装的是OpenVX的应用程序,默认为Python应用程序。

图3-10. 语义分割

3.4.2.通过命令运行

语义分割的C/C++和Python应用程序位于/usr/local/x-linux-ai/object-detection/目录中,可以通过运行程序加-h参数来获取更多帮助信息:

# cd /usr/local/x-linux-ai/semantic-segmentation/ # ls -la stai_mpu_semantic_segmentation.py

为了简化demo的启动,在应用程序目录下有配置好的启动脚本:

使用相机输入启动语义分割demo

launch_python_semantic_segmentation.sh

使用图片输入启动语义分割demo

launch_python_semantic_segmentation_testdata.sh

3.4.3.demo展示

通过demo启动器启动默认为使用相机输入,和命令启动中使用相机输入的脚本运行结果一致,这里以C/C++程序为例,具体测试情况如下:

# cd /usr/local/x-linux-ai/semantic-segmentation/ # ./launch_python_semantic_segmentation.sh #或者点击demo启动器图标

图3-11. 摄像机输入

运行图片输入的程序脚本前,需要准备识别的图片,这里以一张人正在办公的图片为例,图片放置目录为:

/usr/local/x-linux-ai/semantic-segmentation/models/deeplabv3/testdata

然后运行脚本,这里以C/C++应用程序为例。

# cd /usr/local/x-linux-ai/semantic-segmentation/models/deeplabv3/testdata # ls -la -rwxr--r-- 1 root root 102821 9 20 23:14 person-work.jpg # cd /usr/local/x-linux-ai/semantic-segmentation # ./launch_python_semantic_segmentation_testdata.sh

运行结果如下:

图3-12. 图片输入

4. 参考资料

lX-Linux-AI-Tool

lST 官方Wiki

2025-04-25

喜讯!米尔电子与安路科技达成IDH生态战略合作,共筑FPGA创新生态

以芯为基,智创未来。近日,领先的嵌入式模组厂商-米尔电子正式与国产FPGA企业安路科技达成IDH生态战略合作。双方将围绕安路科技飞龙SALDRAGON系列高性能FPSoC,联合开发核心板、开发板及行业解决方案,助力开发者开发成功,加速工业控制、边缘智能、汽车电子等领域的创新应用落地。米尔电子&安路科技IDH生态合作证书硬核技术+生态协同安路科技作为国产FPGA领域的标杆企业,其S

2025-04-25

名单揭晓,狂送30套开发板!米尔-安路飞龙派「硬核创造力」

经过米尔电子和安路科技的严格筛选,30位「硬核玩家」从千帆竞逐中脱颖而出,正式成为米尔-安路飞龙派创意秀的玩家。开发者们将以MYD-YM90X开发板为起点,开启一场FPGA的盛宴,在安路飞龙派的赛道上探索无限可能!现将入选的30位开发者/团队名单公布如下(排名不分先后):入选名单后续流程第一步:板卡领取入选的开发者将在近日收到米尔工作人员的联系,我们将为您提供专属优惠券,以便您以1元的价格在myi

2025-04-17

如何在米尔-STM32MP257开发板上实现环境监测系统

本文将介绍基于米尔电子MYD-LD25X开发板(米尔基于STM35MP257开发板)的环境监测系统方案测试。摘自优秀创作者-lugl4313820一、前言环境监测是当前很多场景需要的项目,刚好我正在论坛参与的一个项目:Thingy:91X 蜂窝物联网原型开发平台的试用。把两个项目结合起来,实现一个简单的环境监测系统。二、硬件平台1、米尔-STM32MP257开发板2、Thingy:91X三、项目规

2025-04-10

OpenCV行人检测应用方案--基于米尔全志T527开发板

本文将介绍基于米尔电子MYD-LT527开发板(米尔基于全志T527开发板)的OpenCV行人检测方案测试。摘自优秀创作者-小火苗一、软件环境安装1.安装OpenCVsudoapt-getinstalllibopencv-devpython3-opencv2.安装pipsudoapt-getinstallpython3-pip二、行人检测概论使用HOG和SVM构建行人检测器的关键步骤包括:准备训练

2025-04-03

免费送30套开发板!米尔-安路飞龙派创意秀限时活动

大赛简介为鼓励工程师勇于创新探索的精神,提升实践动手能力,更深度的体验安路飞龙派产品,米尔电子发起“米尔基于安路DR1M90开发板创意秀”,提供米尔安路DR1M90开发板支持开发者创新应用。报名条件:需关注米尔电子公众号的用户;报名对象:面向企业、创客团队、工程师、电子爱好者、研究院等人士,不限个人或团体形式参赛。大赛日程01-活动申请【时间:即日起-2025/04/21】在线填《报名申请表》(见

2025-03-20

一篇文章玩转T113的ARM+RSIC V+DSP三核异构!

近年来,随着半导体产业的快速发展和技术的不断迭代,物联网设备种类繁多(如智能家居、工业传感器),对算力、功耗、实时性要求差异大,单一架构无法满足所有需求。因此米尔推出MYD-YT113i开发板(基于全志T113-i)来应对这一市场需求。米尔基于全志T113-i核心板及开发板part 01T113-i芯片及OpenAMP简介T113-i芯片简介T113-i由两颗ARM A7 、一颗C906(RISC

2025-03-13

ST×米尔STM32MP25x高阶实战培训会

STM32MP25x是ST推出的搭载了双核Cortex-A35@1.5 GHz和Cortex-M33@400 MHz的微处理器。米尔电子基于STM32MP25x推出了MYD-LD25X开发板,开发板配备丰富的扩展接口。为助力开发者深度掌握与应用STM32MP25x处理器,米尔将与ST在2025年4月11日和2025年4月18日分别于深圳、上海联合举办线下高阶实战培训会,本次培训在上一期“Bring

2025-03-13

瑞萨交流日进行中,米尔演讲-RZ/T2H高性能模组赋能工业产品创新

3月12日,2025瑞萨工业以太网技术日在深圳拉开序幕。会议全方位解读瑞萨电子最新EtherCAT/PROFINET/EIP解决方案,洞察行业发展趋势,助力企业高效开发更具竞争力的工业以太网产品。米尔电子作为瑞萨的IDH生态合作伙伴发表演讲,并展出RZ/T2H的核心板开发板、技术方案等。米尔活动现场会上,米尔电子产品经理张先生发表了题为"米尔RZ/T2H高性能模组赋能工业产品创新&quo

2025-03-13

米尔闪耀德国纽伦堡Embedded World 2025,展现嵌入式技术无限可能

2025年3月11日,全球领先的嵌入式解决方案提供商米尔电子,在德国纽伦堡盛大亮相全球规模最大的嵌入式系统展览会Embedded World 2025。此次展会,米尔电子携多款重磅新品和前沿技术方案惊艳登场,为嵌入式开发者带来了一场科技盛宴。米尔展台现场展会现场,米尔电子展示全系列产品,基于国内外知名厂商ST、TI、NXP、瑞萨、AMD(Xilinx)、瑞芯微、全志、新唐、芯驰、海思、紫光同创等主

2025-03-07

六城共启 | 米尔邀您预约2025瑞萨工业以太网技术日

随着工业4.0和工业物联网(IIoT)的发展,现代制造工厂设备的数据传输和自动化控制对实时性、带宽和可靠性提出了更高要求。各类工业以太网技术的普及和迭代不断为拓扑节点设备的确定性、安全通信提供了保障。聚焦工业4.0核心需求,瑞萨电子将于2025年3-4月在全国六大城市(深圳、广州、北京、苏州、西安、上海)巡回举办2025瑞萨工业以太网技术日,为工程师与企业决策者提供实时通信技术最佳解决方案,通过案