基于iMX6ULL处理器的监控平台体验--米尔MYD-Y6ULX-V2开发板

2023-05-24

3214

来源:米尔电子

本篇测评由电子发烧友的优秀测评者“HonestQiao”提供。

评测规划

米尔MYD-Y6ULX-V2开发板上带有SIM卡的插槽,于是结合我之前的使用米尔

板子的经验,想制作一个远程监控的平台。

不过通过硬件手册了解到,板子自身不带有LTE模块,需要安装一个Mini PCI-E接口的LTE 模块才能够使用4G网络,且仅支持仅支持移远EC20型号。

而手头暂时没有这个型号的LTE模块,于是退而且其次,使用有线网络来进行数据的传输。

这块板子的full镜像,提供了通过V4L对USB摄像头的支持,直接插接上USB摄像头就能使用了。

最终,具体的评测规划如下:

使用米尔MYD-Y6ULX-V2开发板提供摄像头监控数据

使用OLED呈现开发板的设备负载、IP地址和服务信息

使用PyQT5开发监控显示界面

使用opencv进行人脸识别检测

硬件准备

海康威视USB摄像头 使用USB连接的摄像头即可

SSD1306 OLED

USB2TTL

米尔MYD-Y6ULX-V2开发板

镜像烧录

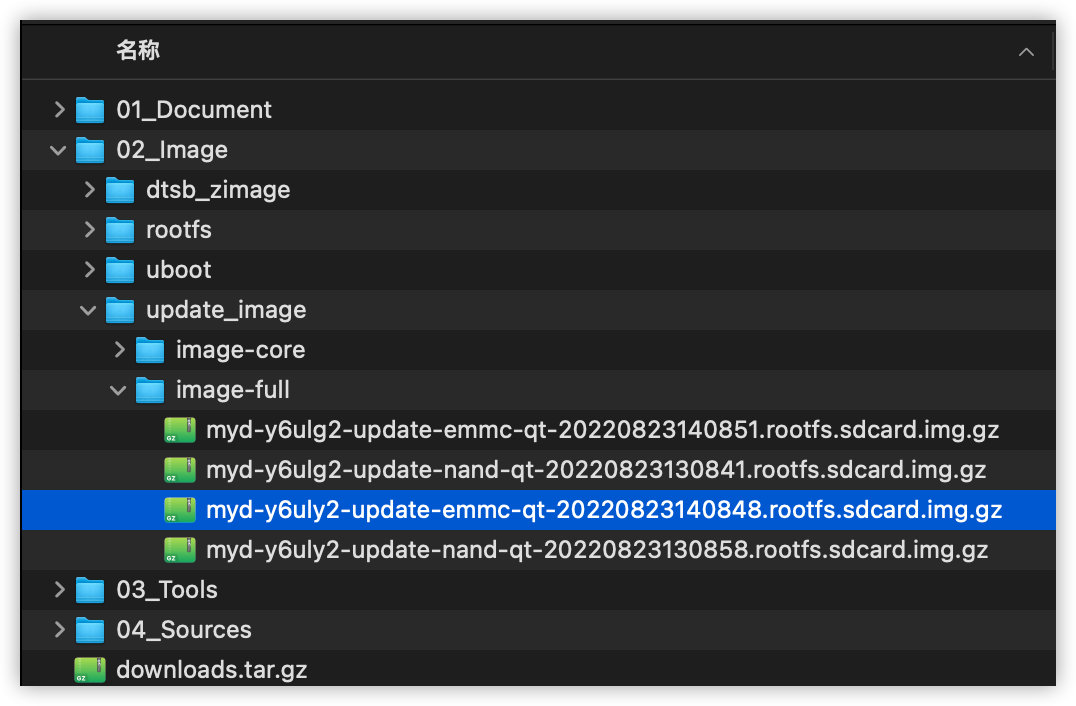

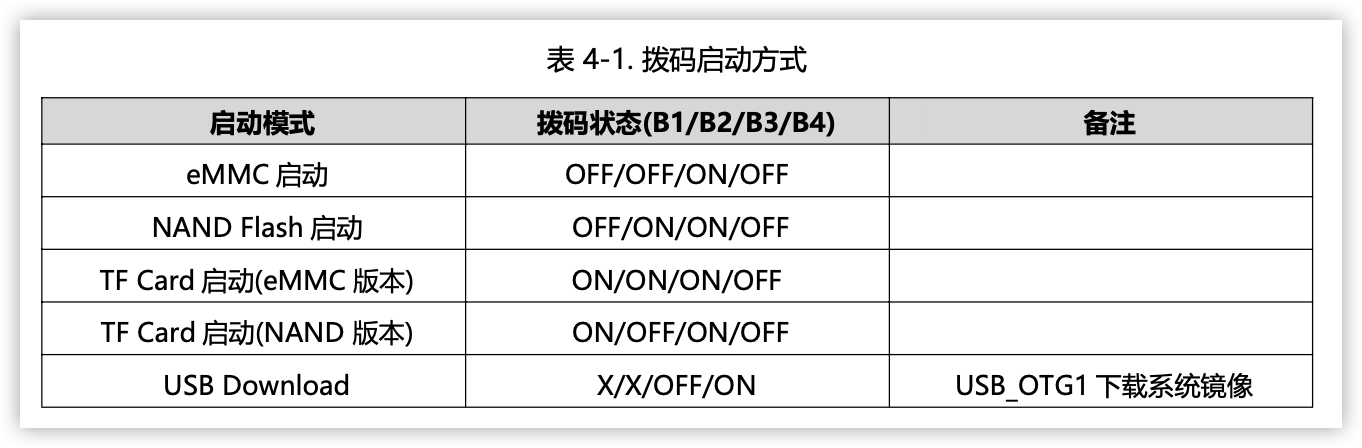

根据使用手册,选用如下的镜像,并按照手册设定好启动方式,进行烧录更新。

镜像类型:

烧录方式:

拨码开关

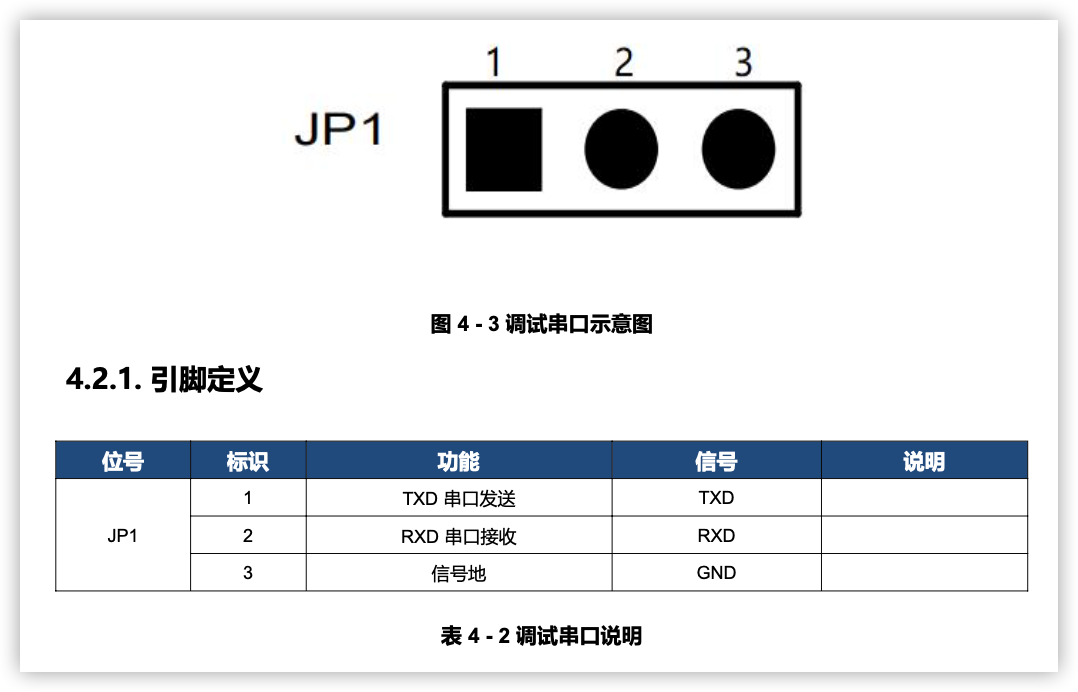

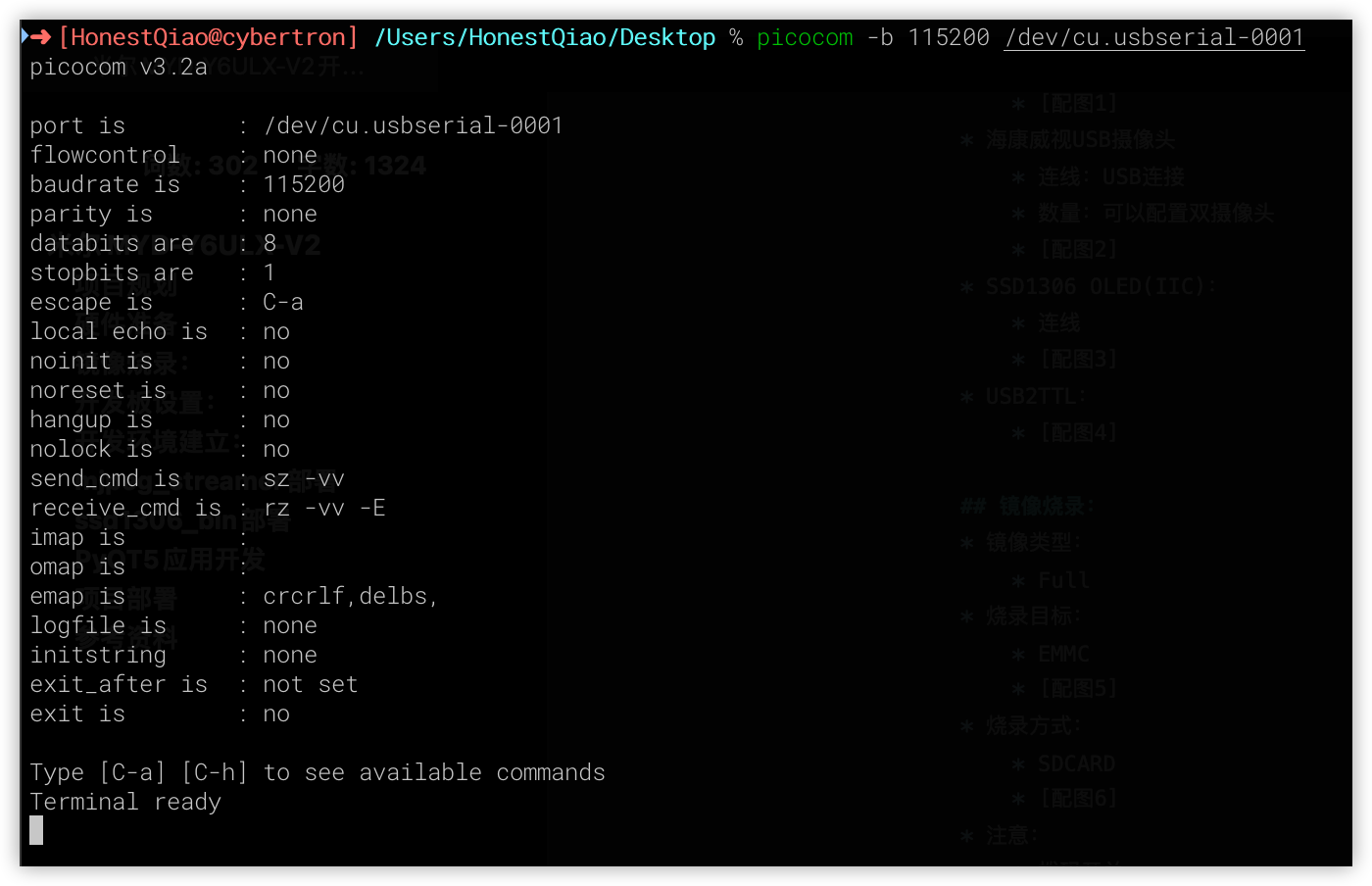

连接调试串口:

烧录:

验证:

更新成功后,断电,然后将拨码开关设置回eMMC启动模式,重启上电开机,最终会看到如下的启动信息,其中NXP i.MX Release Distro 5.10-gatesgarth表示已经更新到了当前系统:

开发板设置

在更新完毕后,需要对开发板进行一些基础的设置,以方便后续进一步操作。

eth0、eth1的IP设置: 参考:7.2. 通用网络配置

静态配置示例如下:

[Match] Name=eth0 [Network] Address=192.168.1.177/24 Gateway=192.168.1.1 DNS=192.168.1.1

动态配置示例如下:

[Match] Name=eth0 [Network] DHCP=yes EOF

配置后,可以重启网络服务,然后查看结果:

service systemd-networkd restart ifconfig

时区设置:

使用vi修改:/etc/sysconfig/clock

ZONE="Asia/Shanghai" UTC=true ARC=false

ntpd对时设置

使用vi修改:/etc/sysconfig/ntpd

# Drop root to id 'ntp:ntp' by default. OPTIONS="-u ntp:ntp -p /var/run/ntpd.pid" # Set to 'yes' to sync hw clock after successful ntpdate SYNC_HWCLOCK=yes #make no into yes; BIOS的时间也会跟着修改 # Additional options for ntpdate NTPDATE_OPTIONS=""

使用vi修改:/etc/ntp.conf

restrict default kod nomodify notrap nopeer noquery # restrict -6 default kod nomodify notrap nopeer noquery #针对ipv6设置 # 允许本地所有操作 restrict 127.0.0.1 #restrict -6 ::1 # 允许的局域网络段或单独ip restrict 10.0.0.0 mask 255.0.0.0 nomodify motrap restrict 192.168.0.0 mask 255.255.255.0 nomodify motrap restrict 192.168.1.123 mask 255.255.255.255 nomodify motrap # 使用上层的internet ntp服务器 server cn.pool.ntp.org prefer server 0.asia.pool.ntp.org server 3.asia.pool.ntp.org server 0.centos.pool.ntp.org iburst # 如果无法与上层ntp server通信以本地时间为标准时间 server 127.127.1.0 # local clock fudge 127.127.1.0 stratum 10 # 计算本ntp server 与上层ntpserver的频率误差 driftfile /var/lib/ntp/drift # Key file containing the keys and key identifiers used when operating # with symmetric key cryptography. keys /etc/ntp/keys #日志文件 logfile /var/log/ntp.log

service ntpd restart date

查看结果:

远程连接:

以上设置完成后,就可以在其他电脑上,使用ssh远程连接,来连接开发板了。

首先在开发板上,为root用户设置密码:

passwd root

然后,在其他电脑上,使用ssh工具进行远程连接:

Windows系统可以视同使用Putty或者mobaxterm,Linux和macOS系统可以直接使用ssh命令

ssh root@192.168.1.177# 出现下一行提示附后,就可以输入命令了:root@myd-y6ull14x14:~#root@myd-y6ull14x14:~# uname -aLinux myd-y6ull14x14 5.10.9-1.0.0+g062cea228 #1 SMP PREEMPT Fri Aug 12 02:04:17 UTC 2022 armv7l armv7l armv7l GNU/Linux

开发环境建立

米尔为MYD-Y6ULX-V2开发板提供了详细的开发环境建立的指导,参考《MYD-Y6ULX_Linux软件开发指南.pdf》即可完成所需要的工作。

开发环境需要在一个Ubuntu环境下建立,而不是开发板自身的系统上。

从开发板的资料包页面,下载光盘镜像:http://down.myir-tech.com/MYD-Y6ULX/,也可以从百度网盘下载相应的资料包。

首先安装基础工具包,并进行工作目录的构建:

sudo apt-get install gawk wget git-core diffstat unzip texinfo gcc-multilib build-essential chrpath socat cpio python3 python3-pip python3-pexpect xz-utils debianutils iputils-ping python3-git python3-jinja2 libegl1-mesa libsdl1.2-dev mkdir -p ~/MYD-Y6ULX-devel export DEV_ROOT=~/MYD-Y6ULX-devel sudo mkdir /media/cdimage sudo mount -o loop ~/Downloads/MYD-Y6ULX_L5.10.9_20220826.iso /media/cdimage cp -r /mnt/cdimage/02_Images $DEV_ROOT/ cp -r /mnt/cdimage/03_Tools $DEV_ROOT/ cp -r /mnt/cdimage/04_Sources $DEV_ROOT/

cd $DEV_ROOT/03_Tools/Tools_chain/ bash fsl-imx-fb-glibc-x86_64-myir-image-full-cortexa7t2hf-neon-myd-y6ull14x14-toolchain-5.10-gatesgarth.sh . /opt/test5.10/environment-setup-cortexa7t2hf-neon-poky-linux-gnueabi $CC -v

安装编译工具链时的提示:安装到/opt/test5.10目录

安装完成后的验证:

06.

mjpg_streamer部署

要使用到摄像头,并对外提供监控数据,使用mjpg_streamer最合适了。

在网上也有不少 iMX6移植原版mjpeg-streamer的文章可供参考,不过我查看后大受误导。

直接使用我之前的版本,进过简单的修改,就能使用MYD-Y6ULX-V2开发板的编译工具链进行成功编译了。

mjpg_streamer分支版本:https://github.com/jacksonliam/mjpg-streamer

下载地址:https://github.com/jacksonliam/mjpg-streamer/archive/refs/heads/master.zip

交叉编译:

使用交叉编译环境的CC设置即可,但需要先注释掉mjpg_streamer源码中原有的gcc设置,具体操作步骤如下:

cd mjpg-streamer/mjpg-streamer-experimental

find -name "Makefile" -exec sed -i "s/CC = gcc/#CC = gcc/g" {} ;

grep -rn 'CC = gcc' *

make clean

make

完成编译后,结果如下:

带so文件部署

使用scp将以上文件拷贝到开发板

ssh root@192.168.1.177 "mkdir ~/mjpeg_server/" scp mjpg_streamer root@192.168.1.177:~/mjpeg_server/ scp *.so root@192.168.1.177:~/mjpeg_server/

mjpeg_streamer测试

查看摄像头设备

查看设备指令:v4l2-ctl --list-devices

从上图可以看出,识别到了连接的USB摄像头HIK 720P Camera,对应的第一个设备地址/dev/video2可以被mjpg_streamer调用。

启动mjpg_streamer测试:

cd ~/mjpeg_server ./mjpg_streamer -i "input_uvc.so -d /dev/video2 -n -r 640x480 -f 10" -o "output_http.so -w ./"

默认启动的mjpg_streamer是可以任意访问的,这很危险。但可以使用-c 用户名:密码来设置一个访问密码,可以参考下图中的指令:

访问测试:

镜像烧录ssd1306_bin部署

我所使用的SSD1306 OLED使用IIC通讯的,之前我也使用过一个Linux环境下的ssd1306工具。

经过尝试,这个工具可以使用MYD-Y6ULX-V2开发板的编译工具链进行编译和使用。

下载地址:https://github.com/armlabs/ssd1306_linux/archive/refs/heads/master.zip 交叉编译:

修改配置文件 Makefile,具体修改如下:

修改完成后,进行编译,编译完成后,部署ssd1306_bin一个文件即可

make ls -l ssd1306_bin # 部署文件到开发板 scp ssd1306_bin root@192.168.1.177:~/mjpeg_server/

硬件连接

参考手册上的说明,进行硬件的连接。我所使用的OLED使用到了VDD_5V、DGND、I2C2_SCL、I2C2_SDA。务必要注意所使用的OLED的电压,有的只能使用3.3V,使用5V会完蛋。

OLED显示测试

上述硬件连接完成后,就可以远程连接到开发板,进行测试了。

然后,进行显示测试

cd ~/mjpeg_server ./ssd1306_bin -n 1 -I 128x64 ./ssd1306_bin -n 1 -c ./ssd1306_bin -n 1 -r 0 ./ssd1306_bin -n 1 -x 0 -y -0 -m "Hello World!nnI'm MYD-Y6ULX-V2."

开发板应用综合部署

完成以上两项工作,开发板部分的基础工作就完成了,可以写一个启动脚本来进行控制,具体如下:

为了安全访问,在脚本中设置了访问的用户名和密码,可以根据实际需要进行修改。

以下的操作,都需要远程连接到开发板上进行。

服务启动脚本:~/mjpeg_server/mjpeg_server_start.sh

#!/bin/bash

cd "${0%/*}"

killall mjpg_streamer >/dev/nul 2>&1

device=$(v4l2-ctl --list-devices | grep 'Camera' -A1 | grep /dev/video | head -1 | awk '{print $NF}')

./mjpg_streamer -i "input_uvc.so -d $device -n -r 640x480 -f 10" -o "output_http.so -w ./ -c test:test123" &

./ssd1306_bin -n 1 -I 128x64

./ssd1306_bin -n 1 -r 0

let count=0

while true

do

nowdate="$(date '+%Y-%m-%d %H:%M:%S')"

load="$(w | head -1 | sed -e 's/^.*average: //' | cut -d ',' -f 1)"

temp=$(echo "scale=1;$(cat /sys/devices/virtual/thermal/thermal_zone0/temp)/1000" | bc)

ipstr=" ${nowdate}n L:${load} T:${temp}"

if [[ $count -gt 0 ]];then

./ssd1306_bin -n 1 -x 0 -y 0 -m "${ipstr}"

else

./ssd1306_bin -n 1 -c

ipstr="${ipstr}n**-*-IP Address-*-**"

i=0

for ip in $(ip addr show | grep -v "127.0.0.1" | awk -F'[ /]+' '{if($0 ~ / inet /) print $3;}')

do

let i=i+1

ipstr="${ipstr}nIP${i}: ${ip}"

done

ipstr="${ipstr}nSRV: ip:8080/?action"

ipstr="${ipstr}n =stream"

echo -e "${ipstr}"

./ssd1306_bin -n 1 -x 0 -y 0 -m "${ipstr}"

fi

let count=count+1

if [[ $count -gt 15 ]];then

let count=0

fi

sleep 1

done开机启动:

chmod u+x /home/root/mjpeg_server/mjpeg_server_start.sh

screen -S mjpeg_server /home/root/mjpeg_server/mjpeg_server_start.sh

配置完成后,就可以重新启动开发板,OLED显示屏上会显示对应的信息:

PyQT5应用开发

MYD-Y6ULX-V2开发板的full环境支持使用QT5进行应用开发,但实际使用中,需要屏幕配合。

我手头没有对应的屏幕,所以这一步的工作,就在电脑上进行,并使用PyQT5进行开发。

具体要做的工作如下:

操作界面开发

mjpeg流读取显示

人脸识别

其中人脸识别部分,参考了:* opencv快速入门人脸检测与人脸识别

涉及到具体的代码的开发,我就直接上代码了,感兴趣的同学,可以查看代码进行学习。

from PyQt5 import QtWidgets

from PyQt5.QtGui import QImage, QPixmap, QKeySequence

from PyQt5.QtCore import QThread

import sys, cv2, threading, random, signal

import numpy as np

import socket

import time, datetime

import requests

from requests.auth import HTTPBasicAuth

# 0-摄像头 1-socket 2-from remote

CAMERA_SOURCE = 2

CAMERA_LOCAL_INDEX = 0 # 如果使用本地摄像头,则表示其videoN的N

CAMERA_SOCKET_PORT = 8888 # 如果视同socket,设置端口

# CAMERA_REMOTE_URL = "http://192.168.1.15:8080/live.mjpg"

CAMERA_REMOTE_URL = "http://192.168.1.177:8080/?action=stream"

CAMERA_SOURCE_NAME = ["USB摄像头", "网络图像流", "米尔MYD-Y6ULX-V2摄像头监控"]

AUTH_CONFIG = {"user":"test","pass":"test123"}

FACE_DETECTION = True

if FACE_DETECTION == True:

# https://blog.csdn.net/FontThrone/article/details/105314973

# https://github.com/FontTian/DS-Exhibitio

face_cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml')

face_cascade.load('./haarcascades/haarcascade_frontalface_default.xml')

face_box_colors = [

(255, 0, 0),

(0, 255, 0),

(0, 255, 0),

(255, 255, 0),

(255, 0, 255),

(0, 255, 255),

(255, 128, 128),

(128, 255, 128),

(128, 255, 128),

(255, 255, 128),

(255, 128, 255),

(128, 255, 255)

]

# 应用定义

app = QtWidgets.QApplication(sys.argv)

window_w, window_h = 640, 480 # 窗口宽度和高度

scale = 0.58 # 视频信息宽高比

# 界面定义

Form = QtWidgets.QWidget()

Form.setWindowTitle(CAMERA_SOURCE_NAME[CAMERA_SOURCE])

Form.resize(window_w, window_h)

# 窗口大小改变时自动调整按钮

def windowResize(self):

global window_w, window_h, scale

window_w = Form.width() # 窗口宽度

window_h = Form.height() # 窗口高度

label.setGeometry(0,0, window_w, int(window_w*scale)) # 调整 QLabel 尺寸

btn1.setGeometry(10, window_h-40,70,30) # 调整按钮位置

btn2.setGeometry(80, window_h-40,70,30) # 调整按钮位置

btn3.setGeometry(window_w - 80, window_h-40,70,30) # 调整按钮位置

Form.resizeEvent = windowResize # 设置窗口大小改变时触发

# 关闭应用时的处理

ocv = True # 设置是否处理视频

def closeOpenCV(self):

global ocv, output

ocv = False # 关闭窗口时,停止处理视频

print("关闭程序")

try:

output.release() # 关闭窗口时,释放视频处理资源

except:

pass

Form.closeEvent = closeOpenCV # 窗口关闭时触发

label = QtWidgets.QLabel(Form)

label.setGeometry(0,0, window_w, int(window_w*scale)) # 设置 QLabel 的位置和大小

# 存储文件时使用的文件名

def rename():

# return str(random.random()*10).replace('.','')

return datetime.datetime.now().strftime('%Y%m%d_%H%M%S')

photo = False # 按下拍照按钮时,设置处于拍照状态

# 按下拍照按钮时的处理

def takePhoto():

global photo

photo = True # 设定拍照状态为True

print("马上拍照")

btn1 = QtWidgets.QPushButton(Form)

btn1.setGeometry(10, window_h-40,70,30) # 设置拍照按钮的位置和大小

btn1.setText('拍照')

btn1.clicked.connect(takePhoto) # 按下拍照按钮时触发

fourcc = cv2.VideoWriter_fourcc(*'mp4v') # 设置视频中的存储格式

recorderType = False # 按下录像按钮时,设置处于录像状态

# 按下录像按钮时的处理

def recordVideo():

global recorderType, output

if recorderType == False:

# 如果按下按钮时没有在录像,则开始录像

# 设定存储的视频信息

output = cv2.VideoWriter(f'videos/{rename()}.mp4', fourcc, 20.0, (window_w, int(window_w*scale)))

recorderType = True # 设置正在录制状态

btn2.setGeometry(80, window_h-40,200,30) # 根据显示内容设置大小

btn2.setText('录像中,点击停止保存')

else:

# 如果按下按钮时正在在录像,则停止录像

output.release() # 释放视频存储资源

recorderType = False # 设置非录制状态

btn2.setGeometry(80, window_h-40,70,30) # 根据显示内容设置大小

btn2.setText('录像')

btn2 = QtWidgets.QPushButton(Form)

btn2.setGeometry(80, window_h-40,70,30) # 设置录像按钮的位置和大小

btn2.setText('录像')

btn2.clicked.connect(recordVideo) # 按下录像按钮时触发

# 按下退出按钮时的处理

def quitApp():

global video_server

print("退出程序")

closeOpenCV(False)

app = QtWidgets.QApplication.instance()

app.quit()

btn3 = QtWidgets.QPushButton(Form)

btn3.setGeometry(window_w-80, window_h-40,70,30) # 设置退出按钮的位置和大小

btn3.setText('退出')

btn3.clicked.connect(quitApp) # 按下退出按钮时触发

# 人脸识别处理

def face_detection_process(frame):

if FACE_DETECTION == True:

face_count = 0

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

faces = face_cascade.detectMultiScale(gray, 1.3, 5)

for (x, y, w, h) in faces:

color = face_box_colors[face_count % len(face_box_colors)]

cv2.rectangle(frame, (x, y), (x + w, y + h), color, 2)

face_count+=1

# 此处省略本项目用不到的数百行...

# mjpeg数据流处理服务

def mjpeg_remote_server():

global window_w, window_h, scale, photo, output, recorderType, ocv

r = requests.get(CAMERA_REMOTE_URL, auth=HTTPBasicAuth(AUTH_CONFIG["user"], AUTH_CONFIG["pass"]), stream=True)

if(r.status_code != 200):

print("Received unexpected status code {}".format(r.status_code))

return

count = 0

is_first = False

recv_data_mjpeg = bytes()

for recv_data in r.iter_content(chunk_size=1024):

if not ocv:

break

count+=1

if count % 10000 == 1:

print("trecv stream success")

recv_data_mjpeg += recv_data

a = recv_data_mjpeg.find(b'xffxd8')

b = recv_data_mjpeg.find(b'xffxd9')

if not (a != -1 and b != -1):

continue

mjpg_data_raw = recv_data_mjpeg[a:b+2]

recv_data_mjpeg = recv_data_mjpeg[b+2:]

mjpeg_data = np.frombuffer(mjpg_data_raw, 'uint8')

img = cv2.imdecode(mjpeg_data, cv2.IMREAD_COLOR)

# cv2.imshow('stream', img)

if not is_first:

is_first = True

sp = img.shape

sz1 = sp[0] #height(rows) of image

sz2 = sp[1] #width(colums) of image

sz3 = sp[2] #the pixels value is made up of three primary colors

print('网络图像: width=%d theight=%d tnumber=%d' % (sz1, sz2, sz3))

scale = sz1/sz2

frame = cv2.resize(img, (window_w, int(window_w*scale))) # 改变帧大小

if photo == True:

name = rename() # 设置文件名称

name_save = f'photos/{name}.jpg'

print("照片存储:%s" % name_save)

cv2.imwrite(name_save, frame) # 存储图片

photo = False # 拍照完,设置非拍照状态

if recorderType == True:

output.write(frame) # 按下录像按钮时,输出到存储文件

face_detection_process(frame)

frame = cv2.cvtColor(frame, cv2.COLOR_BGR2RGB) # 设置为 RGB

height, width, channel = frame.shape

bytesPerline = channel * width

img = QImage(frame, width, height, bytesPerline, QImage.Format_RGB888)

label.setPixmap(QPixmap.fromImage(img)) # 显示

if CAMERA_SOURCE == 2:

video_server = QThread()

video_server.run = mjpeg_remote_server

video_server.start()

Form.show()

sys.exit(app.exec_())设置好开发板的MJPEG视频地址,然后启动上面的python程序,就能打开如下界面了:

如果画面中有人脸,就会自动识别了:

2025-09-11

“一芯四用”,米尔RK3576如何同时驾驭4路YOLOv8视频流?

在科技飞速发展的当下,人工智能与边缘计算的融合正以前所未有的速度重塑着我们的生活。RK3576芯片拥有4核Cortex-A72以及4核Cortex-A53提供基础算力,6TOPS算力NPU来模型推导运算。使用YOLOv8模型时也是手到擒来,接下来随着步伐看看它表现如何。YOLO简介YOLO(You Only Look Once)是当前业界领先的实时目标检测算法系列,以其速度和精度的完美平衡而闻名。

2025-09-04

6TOPS算力驱动30亿参数LLM,米尔RK3576部署端侧多模态多轮对话

关键词:瑞芯微 RK3576、NPU(神经网络处理器)、端侧小语言模型(SLM)、多模态 LLM、边缘 AI 部署、开发板当 GPT-4o 用毫秒级响应处理图文混合指令、Gemini-1.5-Pro 以百万 token 上下文 “消化” 长文档时,行业的目光正从云端算力竞赛转向一个更实际的命题:如何让智能 “落地”?—— 摆脱网络依赖、保护本地隐私、控制硬件成本,让设备真正具备 “看见并对话” 的

2025-09-04

直播预告 | 恩智浦技术日巡回研讨会:技术盛宴,“云端”开席!

9月9日,恩智浦技术日巡回研讨会将在杭州举办!活动同期,恩智浦携手生态合作伙伴,将对会议中精彩的技术演讲全程进行网络直播,让更多的开发者足不出户,也能够直击活动现场,解锁前沿产品方案,共赴“云端”技术盛宴!直播期间,参与观众互动,还有好礼等你拿~~点击文章顶部卡片,或扫描海报二维码,约起来吧!

2025-08-28

米尔发表演讲,并携瑞萨RZ产品亮相2025 Elexcon深圳电子展

2025年8月26日-28日,Elexcon深圳国际电子展在深圳会展中心(福田)1号馆(展台号:1L30)盛大举行。作为全球电子产业链的重要盛会,展会汇聚创新技术与行业解决方案。米尔电子MYIR携RZ系列核心板、开发板等方案Demo亮相瑞萨嵌入式MCU/MPU生态专区,并发表主题演讲。技术盛宴:瑞萨RZ系列产品矩阵亮相展会上,米尔展示了基于RZ/G2L、RZ/G2UL、RZ/T2H的核心板

2025-08-28

留言领奖!2025 STM32研讨会即将启幕,米尔期待与你共会

2025年9月11日及9月17日,STM32研讨会将走进北京和上海,为大家深入解读STM32的中国战略,并围绕STM32在不同领域的最新产品布局和生态展开主题演讲,包括边缘人工智能、电源能源、无线连接、安全等,深入探讨STM32带来的前沿科技成果。同时,STM32还将携手业内多家合作伙伴,展示STM32在更多领域的解决方案及应用实例。欢迎开发者及工程师莅临现场,与ST专家面对面沟通交流,体验不同产

2025-08-28

Qwen2-VL-3B模型在米尔瑞芯微RK3576开发板NPU多模态部署指导与评测

关键词:瑞芯微 RK3576、NPU(神经网络处理器)、端侧小语言模型(SLM)、多模态 LLM、边缘 AI 部署、开发板、RKLLM随着大语言模型(LLM)技术的快速迭代,从云端集中式部署到端侧分布式运行的趋势日益明显。端侧小型语言模型(SLM)凭借低延迟、高隐私性和离线可用的独特优势,正在智能设备、边缘计算等场景中展现出巨大潜力。瑞芯微 RK3576 开发板作为一款聚焦边缘 AI 的硬件平台,

2025-08-14

12路1080P高清视频流,米尔RK3576开发板重塑视频处理极限

在智能视觉技术不断发展的今天,多路摄像数据的处理与传输已成为众多应用场景的核心需求。从智能安防监控领域的全面覆盖,到工业视觉处理网关的精准检测,再到车载环视融合平台的实时驾驶辅助以及智慧社区AI防控的快速响应,多路摄像数据的处理与传输已成为关键需求,而高效且低延时的解决方案则是实现这些应用的核心。目前多路摄像传输方案往往存在一定局限,接入路数有限,难以满足大规模监控场景的需求,且延迟较高,影响实时

2025-08-14

共建生态,米尔将出席2025安路科技FPGA技术沙龙

在数字化浪潮席卷全球的今天,FPGA技术正成为驱动创新的核心引擎。2025年8月21日,深圳将迎来一场聚焦FPGA技术与产业应用的盛会——2025安路科技FPGA技术沙龙。本次沙龙以“定制未来 共建生态”为主题,汇聚行业专家、企业代表及技术开发者,探讨前沿技术趋势,解锁定制化解决方案,共建开放共赢的FPGA生态圈!米尔作为领先的嵌入式处理器模组厂商,将携安路FPGA核心板和开发板亮相,并发表主题演

2025-08-08

如何在RK3576开发板上板端编译OpenCV并搭建应用

本文将介绍基于米尔电子MYD-LR3576开发板(米尔基于瑞芯微 RK3576开发板)的板端编译OpenCV及环境搭建方案的开发测试。摘自优秀创作者-短笛君RK3576具有如下配置:4× Cortex-A72(大核,主频最高 2.2GHz)4× Cortex-A53(小核,主频最高 1.8GHz)NPU(AI加速单元):独立 NPU,算力典型值6 TOPS(INT8)支持 TensorFlow L

2025-08-08

倒计时!米尔-安路飞龙派创意秀奖品等您领~~

创意秀活动进入倒计时阶段2025年米尔-安路飞龙派FPGA FPSoC创意开发大赛即将于8月15日正式收官(原定于6月15日,已延期到8月15日)。作为国产工业级FPGA领域的赛事,本次活动已吸引多支开发团队参与,基于MYD-YM90X开发板产出了众多创新解决方案。现距截稿仅剩7天,米尔特别提醒尚未提交作品的开发者把握最后几天,分享您的技术创作,申领米尔电子的奖品。活动链接:https://mp